Александр Александрович Розов's Blog, page 40

November 5, 2024

Элитка, профукавшая экономику и будущее, теперь винит во всем "ленивых зумеров".

С подачи канала Discovery: IT, технологии, бизнес (https://t.me/c/1252709378/22480) посмотрел подборку свежих публикации в Fortune о зумерах*

Удивительно, насколько существенно это пересекается с обзором, данным ранее в этом журнале**.

Вкратце, о чем идет речь в Fortune:

1) Поколение Z готово бросать работу, если работа не изменяется в соответствии с их потребностями. По всем направлениям самое молодое работающее поколение оказывается самым недовольным своей работой.

2) Немецкие боссы обвиняют в экономических проблемах страны «ленивое» поколение Z, которое берет больничный почти 20 раз в год. Германия находится в структурном кризисе — с падением экспорта, ростом цен на энергоносители и ослаблением конкурентоспособности в ее важнейших секторах. Но, по словам боссов крупнейших предприятий Германии, настоящая проблема в том, что ее работники слишком часто берут больничные.

3) После прохождения нескольких раундов собеседований, устраивающих менеджера по найму и после получения работы, представители поколения Z вынуждены отказываться от предлагаемых им вакансий из-за расходов, связанных с началом новой работы (дресс-код и цена проезда на/с работы), согласно исследованию 2024 года.

Любопытно: сначала положить экономику настолько, что зарплата становится сопоставимой со стоимостью проезда, одежды и жилья. А потом удивляться, что люди не хотят работать.

...Такие дела...

--------------------

*) Публикации в Fortune о зумерах

https://fortune.com/2024/10/29/gen-z-burnout-frontline-customer-service-workers/

https://fortune.com/europe/2024/11/01/german-manufacturers-work-shy-younger-employees-sick/

https://fortune.com/europe/article/why-cant-gen-z-find-jobs-unemployment-mental-health-tiktok/

**) Ранее в этом журнале

2023-11-16 Как "снежинки" победят недеянием ту систему, которая была уверена, что они "никуда не денутся"

https://alex-rozoff.livejournal.com/728306.html

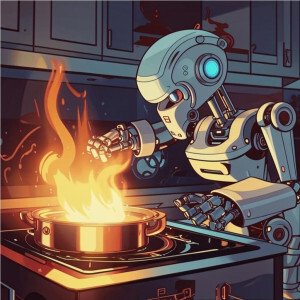

Картина: Лаура Крифка

Удивительно, насколько существенно это пересекается с обзором, данным ранее в этом журнале**.

Вкратце, о чем идет речь в Fortune:

1) Поколение Z готово бросать работу, если работа не изменяется в соответствии с их потребностями. По всем направлениям самое молодое работающее поколение оказывается самым недовольным своей работой.

2) Немецкие боссы обвиняют в экономических проблемах страны «ленивое» поколение Z, которое берет больничный почти 20 раз в год. Германия находится в структурном кризисе — с падением экспорта, ростом цен на энергоносители и ослаблением конкурентоспособности в ее важнейших секторах. Но, по словам боссов крупнейших предприятий Германии, настоящая проблема в том, что ее работники слишком часто берут больничные.

3) После прохождения нескольких раундов собеседований, устраивающих менеджера по найму и после получения работы, представители поколения Z вынуждены отказываться от предлагаемых им вакансий из-за расходов, связанных с началом новой работы (дресс-код и цена проезда на/с работы), согласно исследованию 2024 года.

Любопытно: сначала положить экономику настолько, что зарплата становится сопоставимой со стоимостью проезда, одежды и жилья. А потом удивляться, что люди не хотят работать.

...Такие дела...

--------------------

*) Публикации в Fortune о зумерах

https://fortune.com/2024/10/29/gen-z-burnout-frontline-customer-service-workers/

https://fortune.com/europe/2024/11/01/german-manufacturers-work-shy-younger-employees-sick/

https://fortune.com/europe/article/why-cant-gen-z-find-jobs-unemployment-mental-health-tiktok/

**) Ранее в этом журнале

2023-11-16 Как "снежинки" победят недеянием ту систему, которая была уверена, что они "никуда не денутся"

https://alex-rozoff.livejournal.com/728306.html

Картина: Лаура Крифка

Published on November 05, 2024 13:08

November 4, 2024

Клипофрения: постыдные догмы социал-дарвинизма и неоконсерватизма (итоги поля мнений о власти)

Итоги поля мнений* по тезису

irbis_s

: Власть. Для человека жажда власти — один из основных инстинктов, если не самый основной. "Чтобы они ползали на четвереньках, а мы на них плевали" (c).

irbis_s

: Власть. Для человека жажда власти — один из основных инстинктов, если не самый основной. "Чтобы они ползали на четвереньках, а мы на них плевали" (c).

Это типичный тезис у адептов социал-дарвинизма и неоконсерватизма**, и вот мы его проверили.

На вопрос:Есть ли у вас потребность властвовать над окружающими и унижать окружающих?

"Да" ответили 9.4% - "Нет" ответили 90.6%)

При этом в обсуждении написано 600+ комментов.

Оказалось, что это никакой не основной инстинкт, а патология, свойственная сравнительно небольшой доле индивидов. У кого, где, как и почему такая патология формируется - отдельный вопрос. Но вот что интересно: если читать практически любую свободную дискуссию по темам социальных технологий, то большинство комментов будет принадлежать таким патологическим индивидам с психикой сектантов-кальвинистов, или идейных гопников, или прапорщиков из советских анекдотов.

Но как только их формулировки ставятся в социологический опрос - так сразу оказывается что их точку зрения разделяет не более 1/3, а чаще лишь 1/10 участников.

Сами же эти патологические индивиды публично обижаются, что их, мол, не так поняли.

При том, что в опрос выносятся дословно их тезисы, как в данном случае.

...Такие дела...

-----------------------------

*) Поле мнений: потребность в доминировании над окружающими и в унижении окружающих - правда или нет?

https://alex-rozoff.livejournal.com/829273.html

**) Ранее по теме

https://alex-rozoff.livejournal.com/399877.html

Разбираемся в социально-экономической психологии клипового лавочника (в мире животных)

https://alex-rozoff.livejournal.com/734865.html

Бессвязность консерватизма: блага, дарвинизм, дети, марксизм, прогресс, свобода, секс, труд, эгоизм.

https://alex-rozoff.livejournal.com/399877.html

Человек - тупая, злобная, жадная тварь. Это звучит гордо и есть мера всех вещей. Дилемма?

https://alex-rozoff.livejournal.com/204275.html

Опыт наблюдения за шельмующими демократию от Платона до плинтуса

https://alex-rozoff.livejournal.com/607895.html

Лавочник против безусловного базового дохода: карикатурный рыцарь печального образа капитализма

https://alex-rozoff.livejournal.com/733609.html

Итоги поля мнений: чистый рынок труда (ЧРТ) или безусловный базовый доход (ББД)

https://alex-rozoff.livejournal.com/678300.html

Почему ненависть к UBI и LGBTQIA+ правят миром идей уже фантомного среднего класса?

https://alex-rozoff.livejournal.com/641479.html

Церковь это не про бога, LGBT это не про секс. Итоги опроса о взаимных оскорблениях РКЦ и LGBT

https://alex-rozoff.livejournal.com/337074.html

irbis_s

: Власть. Для человека жажда власти — один из основных инстинктов, если не самый основной. "Чтобы они ползали на четвереньках, а мы на них плевали" (c).

irbis_s

: Власть. Для человека жажда власти — один из основных инстинктов, если не самый основной. "Чтобы они ползали на четвереньках, а мы на них плевали" (c).Это типичный тезис у адептов социал-дарвинизма и неоконсерватизма**, и вот мы его проверили.

На вопрос:Есть ли у вас потребность властвовать над окружающими и унижать окружающих?

"Да" ответили 9.4% - "Нет" ответили 90.6%)

При этом в обсуждении написано 600+ комментов.

Оказалось, что это никакой не основной инстинкт, а патология, свойственная сравнительно небольшой доле индивидов. У кого, где, как и почему такая патология формируется - отдельный вопрос. Но вот что интересно: если читать практически любую свободную дискуссию по темам социальных технологий, то большинство комментов будет принадлежать таким патологическим индивидам с психикой сектантов-кальвинистов, или идейных гопников, или прапорщиков из советских анекдотов.

Но как только их формулировки ставятся в социологический опрос - так сразу оказывается что их точку зрения разделяет не более 1/3, а чаще лишь 1/10 участников.

Сами же эти патологические индивиды публично обижаются, что их, мол, не так поняли.

При том, что в опрос выносятся дословно их тезисы, как в данном случае.

...Такие дела...

-----------------------------

*) Поле мнений: потребность в доминировании над окружающими и в унижении окружающих - правда или нет?

https://alex-rozoff.livejournal.com/829273.html

**) Ранее по теме

https://alex-rozoff.livejournal.com/399877.html

Разбираемся в социально-экономической психологии клипового лавочника (в мире животных)

https://alex-rozoff.livejournal.com/734865.html

Бессвязность консерватизма: блага, дарвинизм, дети, марксизм, прогресс, свобода, секс, труд, эгоизм.

https://alex-rozoff.livejournal.com/399877.html

Человек - тупая, злобная, жадная тварь. Это звучит гордо и есть мера всех вещей. Дилемма?

https://alex-rozoff.livejournal.com/204275.html

Опыт наблюдения за шельмующими демократию от Платона до плинтуса

https://alex-rozoff.livejournal.com/607895.html

Лавочник против безусловного базового дохода: карикатурный рыцарь печального образа капитализма

https://alex-rozoff.livejournal.com/733609.html

Итоги поля мнений: чистый рынок труда (ЧРТ) или безусловный базовый доход (ББД)

https://alex-rozoff.livejournal.com/678300.html

Почему ненависть к UBI и LGBTQIA+ правят миром идей уже фантомного среднего класса?

https://alex-rozoff.livejournal.com/641479.html

Церковь это не про бога, LGBT это не про секс. Итоги опроса о взаимных оскорблениях РКЦ и LGBT

https://alex-rozoff.livejournal.com/337074.html

Published on November 04, 2024 13:39

November 3, 2024

Тупик т.н. "искусственного интеллекта" - итог самообмана некорректным названием "нейронные сети"

Любопытная статья Александра Березина* о тупике искусственного интеллекта во многом пересекается со статьей в этом журнале 5 лет назад.

Причем мы с Березиным незнакомы и не сговаривались.

Более того: с некоторыми его рассуждениями о сложности мозга я не согласен (поскольку есть примеры детальной карты связей биологических нейронных сетей фруктовых мушек и морских зайцев).

Тем не менее общие выводы у Березина подтверждены фактами и объективными отчетами.

Привожу несколько фрагментов из его статьи.

1. Все дело в том, что в основе «Кибертакси», под капотом его концепции, лежит совершенно то же самое, что и под капотом ChatGPT и так называемого современного ИИ в целом. Почему так называемого? Потому что, как здраво отмечают специалисты по искусственному интеллекту, слово «интеллект» в описании этого явления — совершенно лишнее. Причин множество, но ключевая из них в том, что природа единственного известного нам интеллекта (человеческого) не изучена от слова совершенно. Речь не о том, что мы не понимаем в нем какие-то детали: мы не понимаем, что это такое вообще, в целом, в принципе. Нет ни одного определения интеллекта, с которым было бы согласно большинство (или хотя бы половина) ученых, изучающих интеллект.

2. нужно вникнуть в то, как устроен современный искусственный неинтеллект (чуть позже станет ясно, почему мы используем такую приставку).

В основе его всегда лежат нейросети — ПО, которое называют построенным по принципам биологических нейронных сетей. Но по сути это не так, причем сразу по многими причинам. Нейронка — это система так называемых искусственных нейронов, цифровых по своей природе.

Между тем реальный нейроны у вас в голове не цифровые, поскольку некоторые нейроны могут находиться в самых разных состояниях (давать импульсы разной силы), а не только в ограниченный набор сигналов типа «нуля» (нет сигнала) и «единицы» (есть сигнал). А еще они не аналоговые — наука установила и то, и другое совершенно точно. Какие они?

Одни исследователи уверенно говорят, что гибридные: в какой-то части своего функционала цифровые, в какой-то аналоговые. Другие ученые возражают: они не гибридные, они просто конвертируют цифровые сигналы в аналоговые (или наоборот, смотря какого ученого спросить). Правда, зачем им добавлять себе работу такой конвертацией, не очень понятно.

3.Различия между искусственными «нейросетями» и естественными не заканчиваются на том, что «нейрон» в нейросети совершенно точно цифровой, а у нас в голове — какой-то непонятный. На этом они только начинаются. Ключевой принцип обучения современной нейросети — алгоритм обратного распространения ошибки (backpropagation). Уже из названия ясно, что у нас в голове он происходить не может: там, собственно, нет алгоритмов. Это не помешало отдельным исследователям поискать его следы. Но, ожидаемо, никто ничего не нашел.

Перечислять отличия можно долго, но суть читатель уже уловил: «нейроны» и «нейросети» и их «обучения» в ПО Tesla или в ChatGPT имеют не так много общего с нейросетями у нас в голове. Де-факто все существующие искусственные «нейросети» — просто китайская комната. То есть эффективное ПО, умеющее обрабатывать слова так же, как «донейросетевое» ПО умеет обрабатывать числа.

4. попробуем обратиться к конкретным примерам использования нейросетей — и сразу всплывет немало нюансов.

Как работнику СМИ и редактору мне приходится сталкиваться с нейросетями крайне часто. Это эффективное средство оценки качества потенциальных сотрудников. Ведь на сколько-нибудь сложных задачах нейросети стабильно делают характерные ошибки и в переводах, и в написании текстов. Каждый опытный редактор за последний год давно научился быстро отличать текст, автор которого использует ChatGPT любой версии. Подобное экономит время: раньше на понимание того, что продукт работы очередного кандидата может не вызывать у вас восторг, нужно было несколько больше трудозатрат.

Это не значит, что нейросети не используются для генерации контента: используются, и массово. Многие Telegram-каналы и СМИ не очень гонятся за качеством, поэтому часто применяют подобное. Есть и редакторы, поручающие нейронке отредактировать текст в том или ином стиле. Конечно, среди таких редакторов нет людей, блещущих стилем (отчего у них и нет претензий к конечному продукту). Но надо понимать. что медиарынок в нашу эпоху не всегда взыскателен, поэтому находится место и им.

Сходная картина с картинками: качество того, что они генерят, невысокое. Иногда их можно использовать, чаще проще найти нормальное обычное фото. Там, где требования пониже, такие картинки используют действительно часто.

Если мы спросим программистов, пытавшихся использовать нейронки для написания кода, ответ будет очень похожим. Обобщенно он звучит так: если вы кодите на Python простые игрушки для мобилок, то почему бы и нет. Говоришь, что хочешь получить, копируешь выдачу и вставляешь. Что-то оригинальное, принципиально новый продукт — уже нет. На Java примерно так же.

5. точный размер прибыли Waymo нам узнать не удалось. Основная причина: она несет убытки. За первую половину этого года там потеряли два миллиарда долларов. Как минимум по 800 долларов убытка на одну поездку роботакси.

Как у них это получается? Все просто: никаких беспилотных такси у Waymo нет. Как нет их и у кого-либо другого. То, что так называют, это машина, которой управляет нейронка, и за группой которых присматривает удаленный инженер. Автомобиль попал в непонятную ситуацию, затупил и остановился на пустой дороге (обычная история с беспилотником)? Инженер нехотя отложил в сторону смартфон и подсказал, что делать. Ну или вручную вырулил из сложной ситуации.

...Такие дела...

---------------------------

*)12 октября 2024 «Кибертакси» Tesla: первый крупный провал Илона Маска — и первый шаг к схлопыванию пузыря ИИ (Александр Березин)

https://naked-science.ru/article/nakedscience/cybertaxi-tesla-proval

Связанные материалы: отчеты по применению ИИ в программировании

https://resources.uplevelteam.com/gen-ai-for-coding

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=4945566

**) 2019-09-29 Цифровой мир заведомо в тупике. Поиски возвращают экспертов в эру аналоговых схем.

https://alex-rozoff.livejournal.com/156609.html

Причем мы с Березиным незнакомы и не сговаривались.

Более того: с некоторыми его рассуждениями о сложности мозга я не согласен (поскольку есть примеры детальной карты связей биологических нейронных сетей фруктовых мушек и морских зайцев).

Тем не менее общие выводы у Березина подтверждены фактами и объективными отчетами.

Привожу несколько фрагментов из его статьи.

1. Все дело в том, что в основе «Кибертакси», под капотом его концепции, лежит совершенно то же самое, что и под капотом ChatGPT и так называемого современного ИИ в целом. Почему так называемого? Потому что, как здраво отмечают специалисты по искусственному интеллекту, слово «интеллект» в описании этого явления — совершенно лишнее. Причин множество, но ключевая из них в том, что природа единственного известного нам интеллекта (человеческого) не изучена от слова совершенно. Речь не о том, что мы не понимаем в нем какие-то детали: мы не понимаем, что это такое вообще, в целом, в принципе. Нет ни одного определения интеллекта, с которым было бы согласно большинство (или хотя бы половина) ученых, изучающих интеллект.

2. нужно вникнуть в то, как устроен современный искусственный неинтеллект (чуть позже станет ясно, почему мы используем такую приставку).

В основе его всегда лежат нейросети — ПО, которое называют построенным по принципам биологических нейронных сетей. Но по сути это не так, причем сразу по многими причинам. Нейронка — это система так называемых искусственных нейронов, цифровых по своей природе.

Между тем реальный нейроны у вас в голове не цифровые, поскольку некоторые нейроны могут находиться в самых разных состояниях (давать импульсы разной силы), а не только в ограниченный набор сигналов типа «нуля» (нет сигнала) и «единицы» (есть сигнал). А еще они не аналоговые — наука установила и то, и другое совершенно точно. Какие они?

Одни исследователи уверенно говорят, что гибридные: в какой-то части своего функционала цифровые, в какой-то аналоговые. Другие ученые возражают: они не гибридные, они просто конвертируют цифровые сигналы в аналоговые (или наоборот, смотря какого ученого спросить). Правда, зачем им добавлять себе работу такой конвертацией, не очень понятно.

3.Различия между искусственными «нейросетями» и естественными не заканчиваются на том, что «нейрон» в нейросети совершенно точно цифровой, а у нас в голове — какой-то непонятный. На этом они только начинаются. Ключевой принцип обучения современной нейросети — алгоритм обратного распространения ошибки (backpropagation). Уже из названия ясно, что у нас в голове он происходить не может: там, собственно, нет алгоритмов. Это не помешало отдельным исследователям поискать его следы. Но, ожидаемо, никто ничего не нашел.

Перечислять отличия можно долго, но суть читатель уже уловил: «нейроны» и «нейросети» и их «обучения» в ПО Tesla или в ChatGPT имеют не так много общего с нейросетями у нас в голове. Де-факто все существующие искусственные «нейросети» — просто китайская комната. То есть эффективное ПО, умеющее обрабатывать слова так же, как «донейросетевое» ПО умеет обрабатывать числа.

4. попробуем обратиться к конкретным примерам использования нейросетей — и сразу всплывет немало нюансов.

Как работнику СМИ и редактору мне приходится сталкиваться с нейросетями крайне часто. Это эффективное средство оценки качества потенциальных сотрудников. Ведь на сколько-нибудь сложных задачах нейросети стабильно делают характерные ошибки и в переводах, и в написании текстов. Каждый опытный редактор за последний год давно научился быстро отличать текст, автор которого использует ChatGPT любой версии. Подобное экономит время: раньше на понимание того, что продукт работы очередного кандидата может не вызывать у вас восторг, нужно было несколько больше трудозатрат.

Это не значит, что нейросети не используются для генерации контента: используются, и массово. Многие Telegram-каналы и СМИ не очень гонятся за качеством, поэтому часто применяют подобное. Есть и редакторы, поручающие нейронке отредактировать текст в том или ином стиле. Конечно, среди таких редакторов нет людей, блещущих стилем (отчего у них и нет претензий к конечному продукту). Но надо понимать. что медиарынок в нашу эпоху не всегда взыскателен, поэтому находится место и им.

Сходная картина с картинками: качество того, что они генерят, невысокое. Иногда их можно использовать, чаще проще найти нормальное обычное фото. Там, где требования пониже, такие картинки используют действительно часто.

Если мы спросим программистов, пытавшихся использовать нейронки для написания кода, ответ будет очень похожим. Обобщенно он звучит так: если вы кодите на Python простые игрушки для мобилок, то почему бы и нет. Говоришь, что хочешь получить, копируешь выдачу и вставляешь. Что-то оригинальное, принципиально новый продукт — уже нет. На Java примерно так же.

5. точный размер прибыли Waymo нам узнать не удалось. Основная причина: она несет убытки. За первую половину этого года там потеряли два миллиарда долларов. Как минимум по 800 долларов убытка на одну поездку роботакси.

Как у них это получается? Все просто: никаких беспилотных такси у Waymo нет. Как нет их и у кого-либо другого. То, что так называют, это машина, которой управляет нейронка, и за группой которых присматривает удаленный инженер. Автомобиль попал в непонятную ситуацию, затупил и остановился на пустой дороге (обычная история с беспилотником)? Инженер нехотя отложил в сторону смартфон и подсказал, что делать. Ну или вручную вырулил из сложной ситуации.

...Такие дела...

---------------------------

*)12 октября 2024 «Кибертакси» Tesla: первый крупный провал Илона Маска — и первый шаг к схлопыванию пузыря ИИ (Александр Березин)

https://naked-science.ru/article/nakedscience/cybertaxi-tesla-proval

Связанные материалы: отчеты по применению ИИ в программировании

https://resources.uplevelteam.com/gen-ai-for-coding

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=4945566

**) 2019-09-29 Цифровой мир заведомо в тупике. Поиски возвращают экспертов в эру аналоговых схем.

https://alex-rozoff.livejournal.com/156609.html

Published on November 03, 2024 13:03

Раздвоение виртуальной личности Илона Маска на FII: угроза заявлена после ее опровержения

Виртуальное выступление* Илона Маска на 8-й конференции Future Investment Initiative (FII) в Эр-Рияде, разумеется, привлекло внимание публики.

[image error]

Маск говорил о многом, отрывочно, порой с гипертрофированным оптимизмом или наоборот алармизмом, но наиболее странным была пара его тезисов - о численности роботов и о численности людей. Смотрим:

(1) «Через 25 лет будет не менее 10 миллиардов человекоподобных роботов». [Это будет] «самый массовый продукт из когда-либо существовавших». [Роботы будут продаваться по] «низкой цене», от 20 до 25 тысяч долларов за робота, который может делать все».

(2) [Самая значительная угроза, с которой сталкивается человечество, это] «сокращение численности населения мира и падение рождаемости. Это самая большая проблема, которую необходимо решить странам. Если вы не создадите людей, то не будет и человечества. И вся политика в мире не имеет значения».

Гм... Где логика?

Если через к 2050 будет больше универсальных гуманоидных роботов по доступной цене, чем сейчас людей (1), то в снижении числа людей из-за низкой рождаемости нет никакой угрозы(2).

Ну, допустим, вместо сегодняшних 8 млрд. жителей будет 3 млрд., как в начале Космической эры. И что? Производство не пострадает от дефицита персонала - ведь роботы смогут (1) заменить всех производственных и транспортных работников.

То ли у Маска раздвоение личности, то ли он на 10-й минуте забыл, что говорил на 5-й.

...Такие дела...

---------------------------

*) Musk predicts 'more robots than people' by 2040 in latest interview. Here's what else he said, from AI to Zed.

October 29, 2024

https://cybernews.com/news/musk-fii-conference-interview-tesla-robots-ai-cybercab-mars-predictions/

[image error]

Маск говорил о многом, отрывочно, порой с гипертрофированным оптимизмом или наоборот алармизмом, но наиболее странным была пара его тезисов - о численности роботов и о численности людей. Смотрим:

(1) «Через 25 лет будет не менее 10 миллиардов человекоподобных роботов». [Это будет] «самый массовый продукт из когда-либо существовавших». [Роботы будут продаваться по] «низкой цене», от 20 до 25 тысяч долларов за робота, который может делать все».

(2) [Самая значительная угроза, с которой сталкивается человечество, это] «сокращение численности населения мира и падение рождаемости. Это самая большая проблема, которую необходимо решить странам. Если вы не создадите людей, то не будет и человечества. И вся политика в мире не имеет значения».

Гм... Где логика?

Если через к 2050 будет больше универсальных гуманоидных роботов по доступной цене, чем сейчас людей (1), то в снижении числа людей из-за низкой рождаемости нет никакой угрозы(2).

Ну, допустим, вместо сегодняшних 8 млрд. жителей будет 3 млрд., как в начале Космической эры. И что? Производство не пострадает от дефицита персонала - ведь роботы смогут (1) заменить всех производственных и транспортных работников.

То ли у Маска раздвоение личности, то ли он на 10-й минуте забыл, что говорил на 5-й.

...Такие дела...

---------------------------

*) Musk predicts 'more robots than people' by 2040 in latest interview. Here's what else he said, from AI to Zed.

October 29, 2024

https://cybernews.com/news/musk-fii-conference-interview-tesla-robots-ai-cybercab-mars-predictions/

Published on November 03, 2024 04:56

November 2, 2024

Линус Торвальдс считает, что т.н. "Искусственный Интеллект" это 90% маркетинга и 10% реальности

Продолжаем* тему о (мягко говоря) странностях т.н. "Искусственного Интеллекта"

Линус Торвальдс** - создатель ядра Linux,"Чемпион Свободных Программ", персонаж Зала славы интернета, в общем: один из наиболее компетентных людей в мировой IT-сфере.

Теперь читаем, что он сказал по обсуждаемой теме.

Создатель и ведущий разработчик ядра Linux не разочаровал своим характерным цинизмом относительно сути индустрии ИИ в 2024 году. Известный своими высокоинформированными, но неприукрашенными мнениями обо всем, что касается технологий, Торвальдс поморщился, когда резюмировал состояние бизнеса ИИ как «90% маркетинга и 10% реальности». Торвальдс выступил на саммите Open Source в Вене в начале этого месяца, где TFiR взял у него интервью.

далее цитаты:

...Я думаю, что ИИ действительно интересен, и я думаю, что он изменит мир. И в то же время я так ненавижу цикл шумихи, что действительно не хочу в него ввязываться. Так что мой подход к ИИ сейчас заключается в том, что я в основном буду его игнорировать, потому что я считаю, что вся технологическая индустрия вокруг ИИ находится в очень плохом положении... [в настоящее время это] ...90% маркетинга и 10% реальности.

...Через пять лет все изменится, и тогда мы увидим, какой ИИ используется каждый день для реальных рабочих нагрузок.

...Chat GPT отлично демонстрирует [...] и очевидно используется во многих областях, но особенно в графическом дизайне и подобных вещах

далее издание отмечает:

Это не первый случай, когда тяжеловес IT-индустрии задается вопросом о валидности отрасли ИИ.

Всего неделю назад мы сообщали о том, что генеральный директор Baidu высказал еще более пессимистичное мнение — что пузырь ИИ лопнет, и что только 1% компаний продолжат собирать осколки после этого..

...Такие дела...

----------------------------

*) Ранее по теме:

Очередные провалы т.н. "искусственного интеллекта" - "снегопад, снегопад, мы еще не готовы" (с)

https://alex-rozoff.livejournal.com/829059.html

**) https://ru.wikipedia.org/wiki/Торвальдс,_Линус

***) October 28, 2024 Linus Torvalds reckons AI is ‘90% marketing and 10% reality’

https://www.tomshardware.com/tech-industry/artificial-intelligence/linus-torvalds-reckons-ai-is-90-percent-marketing-and-10-percent-reality

Линус Торвальдс** - создатель ядра Linux,"Чемпион Свободных Программ", персонаж Зала славы интернета, в общем: один из наиболее компетентных людей в мировой IT-сфере.

Теперь читаем, что он сказал по обсуждаемой теме.

Создатель и ведущий разработчик ядра Linux не разочаровал своим характерным цинизмом относительно сути индустрии ИИ в 2024 году. Известный своими высокоинформированными, но неприукрашенными мнениями обо всем, что касается технологий, Торвальдс поморщился, когда резюмировал состояние бизнеса ИИ как «90% маркетинга и 10% реальности». Торвальдс выступил на саммите Open Source в Вене в начале этого месяца, где TFiR взял у него интервью.

далее цитаты:

...Я думаю, что ИИ действительно интересен, и я думаю, что он изменит мир. И в то же время я так ненавижу цикл шумихи, что действительно не хочу в него ввязываться. Так что мой подход к ИИ сейчас заключается в том, что я в основном буду его игнорировать, потому что я считаю, что вся технологическая индустрия вокруг ИИ находится в очень плохом положении... [в настоящее время это] ...90% маркетинга и 10% реальности.

...Через пять лет все изменится, и тогда мы увидим, какой ИИ используется каждый день для реальных рабочих нагрузок.

...Chat GPT отлично демонстрирует [...] и очевидно используется во многих областях, но особенно в графическом дизайне и подобных вещах

далее издание отмечает:

Это не первый случай, когда тяжеловес IT-индустрии задается вопросом о валидности отрасли ИИ.

Всего неделю назад мы сообщали о том, что генеральный директор Baidu высказал еще более пессимистичное мнение — что пузырь ИИ лопнет, и что только 1% компаний продолжат собирать осколки после этого..

...Такие дела...

----------------------------

*) Ранее по теме:

Очередные провалы т.н. "искусственного интеллекта" - "снегопад, снегопад, мы еще не готовы" (с)

https://alex-rozoff.livejournal.com/829059.html

**) https://ru.wikipedia.org/wiki/Торвальдс,_Линус

***) October 28, 2024 Linus Torvalds reckons AI is ‘90% marketing and 10% reality’

https://www.tomshardware.com/tech-industry/artificial-intelligence/linus-torvalds-reckons-ai-is-90-percent-marketing-and-10-percent-reality

Published on November 02, 2024 11:37

November 1, 2024

Почему китайская (пекинская) модель научно-технического развития не работает (примеры и объяснения)

РАНЕЕ ПО ТЕМЕ ...Континентальное китайское общество настолько пропитано культом денег, что и получение индивидом высшего образования, и любая дальнейшая деятельность этого индивида в рамках системы, имеет лишь одну цель: приносить деньги этому индивиду. Деньги интересуют ученых во всем мире, но кроме денежного мотива у них все-таки есть интерес к научно-исследовательской деятельности как таковой. Для случая КНР это не то что совсем невозможно, но является редчайшим исключением, экзотической ересью. Как это можно интересоваться чем-то еще кроме денег??? При таких условиях наука работать не может - от слова "совсем". Сколько бы средств не инвестировалось в науку - вместо нее на выходе будет жульничество и имитация.*

А вот современные примеры:

...28 октября 2024. Китайская корпорация авиационной промышленности (AVIC) сообщила, что новый крупногабаритный самолет-амфибия AG600 успешно прошел испытания на соответствие летной годности по минимальной скорости отрыва. Тесты AG600 состоялись в уезде Пучэн провинции Шэньси на северо-западе Китая.**

На самом деле: AVIC AG600 прошел полетный тест 24 декабря 2017.

Кроме того, эта модель практически полностью слизана с японской Shin Maywa 2003.

Но ведь в правительстве сидят идиоты и можно на их тупости поднять денег.

...29 октября 2024. Китайская компания Space Transportation сообщила, что прототип ее сверхзвукового пассажирского самолета Yunxing успешно выполнил испытательный полет. Теперь инженеры намерены подготовить полноразмерный сверхзвуковой самолет к первому полету, который запланирован на 2027 год.***

На самом деле: Yunxing практически полностью слизан с американского SR-71 Blackbird 1964

Но ведь в правительстве сидят идиоты и можно поднять денег на чужой модели 60-летней давности.

Можно привести еще кучу примеров: о космосе, о ядерном синтезе, об IT. Просто эти два примеры хороши своей визуальной банальностью.

Почему в Китае все происходит вот так? Ведь китайцы в других странах вполне адекватно, зачастую очень успешно занимаются наукой и технологиями. Т.е. дело не в каком-то мифическом "китайском менталитете", а в социально-психологических ценностях, установленных на площадке КНР.

После демонтажа маоистской командной системы в 1984-м (реформы Дэн Сяопина) в КНР стала формироваться, как обычно в таких случаях, несколько искаженная но все-таки узнаваемая "западная" система ценностей. Искажение (опять же, как обычно) состояло в некотором преувеличении роли денег в системе жизненных ценностей.

В следующем поколении эта конструкция пришла бы к балансу, но в 2016-м Си Циньпин начал разворот назад к маоизму.

Таким образом, новая система ценностей балы сломана раньше, чем завершила свое формирование.

Но вернуть маоистские ценности не получилось (они абсолютно чужды человеку, хоть ненадолго выбравшемуся в индивидуальную жизнь из программируемого сверху стадно-агрессивного коллектива).

По итогам реформ Дэна и Си никаких ценностей не осталось, кроме денег.

...Такие дела...

------------------------

*) 2024-06-15 О науке Континентального Китая - либо хорошо либо ничего? Еще один великий желто-красный пузырь

https://alex-rozoff.livejournal.com/792737.html

**) 28 октября 2024 Самый большой гидросамолет в мире завершил летные испытания на минимальную скорость отрыва

https://naked-science.ru/community/1001589

AG600 Jiaolong

Разработчик: AVIC

Страна: Китай

Первый полет: 2017

Тип: Многоцелевой самолет-амфибия

http://www.airwar.ru/enc/sea/ag600.html

US-2 (US-1AKai)

Разработчик: Shin Maywa

Страна: Япония

Первый полет: 2003

Тип: Многоцелевой самолет-амфибия

http://www.airwar.ru/enc/sea/us1kai.html

***) 29 октября 2024 Прототип китайского сверхзвукового пассажирского самолета совершил испытательный полет

https://naked-science.ru/community/1002092

SR-71 Blackbird

Разработчик: Lockheed

Страна: США

Первый полет: 1964

Тип: Стратегический высотный разведчик

http://www.airwar.ru/enc/spy/sr71.html

А вот современные примеры:

...28 октября 2024. Китайская корпорация авиационной промышленности (AVIC) сообщила, что новый крупногабаритный самолет-амфибия AG600 успешно прошел испытания на соответствие летной годности по минимальной скорости отрыва. Тесты AG600 состоялись в уезде Пучэн провинции Шэньси на северо-западе Китая.**

На самом деле: AVIC AG600 прошел полетный тест 24 декабря 2017.

Кроме того, эта модель практически полностью слизана с японской Shin Maywa 2003.

Но ведь в правительстве сидят идиоты и можно на их тупости поднять денег.

...29 октября 2024. Китайская компания Space Transportation сообщила, что прототип ее сверхзвукового пассажирского самолета Yunxing успешно выполнил испытательный полет. Теперь инженеры намерены подготовить полноразмерный сверхзвуковой самолет к первому полету, который запланирован на 2027 год.***

На самом деле: Yunxing практически полностью слизан с американского SR-71 Blackbird 1964

Но ведь в правительстве сидят идиоты и можно поднять денег на чужой модели 60-летней давности.

Можно привести еще кучу примеров: о космосе, о ядерном синтезе, об IT. Просто эти два примеры хороши своей визуальной банальностью.

Почему в Китае все происходит вот так? Ведь китайцы в других странах вполне адекватно, зачастую очень успешно занимаются наукой и технологиями. Т.е. дело не в каком-то мифическом "китайском менталитете", а в социально-психологических ценностях, установленных на площадке КНР.

После демонтажа маоистской командной системы в 1984-м (реформы Дэн Сяопина) в КНР стала формироваться, как обычно в таких случаях, несколько искаженная но все-таки узнаваемая "западная" система ценностей. Искажение (опять же, как обычно) состояло в некотором преувеличении роли денег в системе жизненных ценностей.

В следующем поколении эта конструкция пришла бы к балансу, но в 2016-м Си Циньпин начал разворот назад к маоизму.

Таким образом, новая система ценностей балы сломана раньше, чем завершила свое формирование.

Но вернуть маоистские ценности не получилось (они абсолютно чужды человеку, хоть ненадолго выбравшемуся в индивидуальную жизнь из программируемого сверху стадно-агрессивного коллектива).

По итогам реформ Дэна и Си никаких ценностей не осталось, кроме денег.

...Такие дела...

------------------------

*) 2024-06-15 О науке Континентального Китая - либо хорошо либо ничего? Еще один великий желто-красный пузырь

https://alex-rozoff.livejournal.com/792737.html

**) 28 октября 2024 Самый большой гидросамолет в мире завершил летные испытания на минимальную скорость отрыва

https://naked-science.ru/community/1001589

AG600 Jiaolong

Разработчик: AVIC

Страна: Китай

Первый полет: 2017

Тип: Многоцелевой самолет-амфибия

http://www.airwar.ru/enc/sea/ag600.html

US-2 (US-1AKai)

Разработчик: Shin Maywa

Страна: Япония

Первый полет: 2003

Тип: Многоцелевой самолет-амфибия

http://www.airwar.ru/enc/sea/us1kai.html

***) 29 октября 2024 Прототип китайского сверхзвукового пассажирского самолета совершил испытательный полет

https://naked-science.ru/community/1002092

SR-71 Blackbird

Разработчик: Lockheed

Страна: США

Первый полет: 1964

Тип: Стратегический высотный разведчик

http://www.airwar.ru/enc/spy/sr71.html

Published on November 01, 2024 06:46

October 31, 2024

Во-первых: Самайн! (у христиан - Хэллоуин!). Всем хорошей тыквы! Во-вторых: дискуссия по Меганезии

Картинки - это к Самайну (Эдмунд Цечкевич и Рикардо Фалеро).

А дискуссия по Меганезии тут:

https://alex-rozoff.livejournal.com/828823.html?thread=242991255#t242991255

Из особо острых вопросов:

1. Конкурс на должности координаторов – руководителей технического правительства и его секторов.

Кто усредняет "социальный заказ" (карту запросов) для конкурса по минимуму цены выполнения

...А как получается эта карта запросов? - заинтересовалась Лирлав.

- Элементарно, - ответил он, - на электоральных форумах foa обсуждают, чего бы они хотели, и предлагают формулировки. В начале этих формулировок-требований до хрена. Потом похожие формулировки объединяются, под ними подписываются крупные группы по интересам. Когда количество разнообразных формулировок уменьшается до разумного значения, формулировки выставляются на голосование по каждому блоку. Доминанты развития экономики, гуманитарные социально-научные проекты, транспортные и информационные сети, управление природными ресурсами, внутренняя безопасность, внешняя безопасность…

(Мауи и Пеле держащие мир. III. Мини-Рагнарек, *55)

https://proza.ru/2013/09/08/940

...к самоорганизации способны около 80% люди (кроме 2 — 3% социопатов и 17% социальных имбецилов)

Но лишь если есть цель самоорганизации и свобода маневра.

2. Меганезийское правило против формирования опасных монополий

Люди раскрутили фирму, суд решил ее национализировать, расплатившись акциями [национального] фонда.

Где гарантия, что доход хозяев не уменьшится в разы именно из-за того, что управлять будут какие-то чиновники?

Такой гарантии нет. Более того, национализация означает, приоритет фирмы меняется с прибыльности на социальный эффект.

Собственно национализация проводится именно в том случае, если стратегия фирмы оказывает прямое и явное воздействие на социальное благополучие (смысл был показан в Одиссее креативной королевы).

Хозяева национализируемой фирмы могут взять цену национализируемого актива не паями фонда, а деньгами или другими активами.

3. Судьи по жребию и решение проблем с регулированием крупных фирм

- Есть хотя бы образовательный ценз ?

- Нет. Как не было в Афинах [эры Перикла]. А что по-вашему усложнилось в юриспруденции со времен Афин?

- Технологии и финансы. Не так просто разобраться в бухгалтерии международной фирмы типа Самсунг.

- Легко. Сложных корпоративных структур нет, банковской тайны нет, судебный надзор прямой.

Там еще много интересных вопросов.

...Такие дела..

Published on October 31, 2024 03:10

October 30, 2024

Поле мнений: потребность в доминировании над окружающими и в унижении окружающих - правда или нет?

В теме FAQ по циклу Меганезия: риски социально-экономической и военной системы. -

irbis_s

выдвинул гипотезу:

irbis_s

выдвинул гипотезу:

Власть. Для человека жажда власти — один из основных инстинктов, если не самый основной.

"Чтобы они ползали на четвереньках, а мы на них плевали" (c)

https://alex-rozoff.livejournal.com/828823.html?thread=243026071#t243026071

Проверяем гипотезу методом поля мнений.

View Poll: Потребность в доминировании над окружающими и в унижении окружающих

Вариантов ответа всего два, поскольку речь идет (согласно гипотезе irbis_s

) об основном инстинкте властвовать и унижать (и то и другое в комплексе), а не о чем-то расплывчатом с полутонами и градациями.

irbis_s

) об основном инстинкте властвовать и унижать (и то и другое в комплексе), а не о чем-то расплывчатом с полутонами и градациями.

Конструктивные комментарии и аргументированные идеи приветствуются

...Такие дела...

irbis_s

выдвинул гипотезу:

irbis_s

выдвинул гипотезу:Власть. Для человека жажда власти — один из основных инстинктов, если не самый основной.

"Чтобы они ползали на четвереньках, а мы на них плевали" (c)

https://alex-rozoff.livejournal.com/828823.html?thread=243026071#t243026071

Проверяем гипотезу методом поля мнений.

View Poll: Потребность в доминировании над окружающими и в унижении окружающих

Вариантов ответа всего два, поскольку речь идет (согласно гипотезе

irbis_s

) об основном инстинкте властвовать и унижать (и то и другое в комплексе), а не о чем-то расплывчатом с полутонами и градациями.

irbis_s

) об основном инстинкте властвовать и унижать (и то и другое в комплексе), а не о чем-то расплывчатом с полутонами и градациями.Конструктивные комментарии и аргументированные идеи приветствуются

...Такие дела...

Published on October 30, 2024 08:58

October 29, 2024

Очередные провалы т.н. "искусственного интеллекта" - "снегопад, снегопад, мы еще не готовы" (с)

Т.н. искусственный интеллект в виде больших языковых моделей продолжает пробивать днища*, громоздя все более феерические нелепости.

25 октября OpenAI распустила команду консультантов, "оценивающих готовность общества к появлению универсального, или сильного ИИ". Признала провал? Вы будете смеяться, но нет. Основание для роспуска заявлено такое смешное, что все клоуны отдыхают.

Майлс Брандэйдж (глава теперь уже бывшей команды) объяснил это так: "Ни OpenAI, ни какая-либо другая передовая лаборатория не готовы к сильному ИИ, мир тоже не готов. Поясню, я не думаю, что в руководстве OpenAI это утверждение вызывает споры. И его не следует путать с вопросом, окажется ли компания и мир готовы в соответствующее время"

...Гм... Это что было?

Намек на демонстративную коммерциализацию OpenAI Сэмом Альтманом и раздачу бредовых обещаний?**

Или напоминание о бегстве ключевых фигур из OpenAI (включая Суцкевера и Мурати)?

А может, ужас перед лицом нового эпического фейла, о котором ниже:

[цитирую материал от 28.10] Генеративные модели искусственного интеллекта склонны к генерации некорректной информации. Удивительно, но эта проблема затронула и область автоматической транскрипции, где модель должна точно воспроизводить аудиозапись. По данным Associated Press, инженеры-программисты, разработчики и ученые серьезно обеспокоены расшифровками Whisper от OpenAI.

Исследователь из Мичиганского университета обнаружил галлюцинации в восьми из десяти аудиозаписей. Инженер по машинному обучению, изучивший более 100 часов транскрипций Whisper, нашел ошибки более чем в половине из них. А разработчик сообщил, что обнаружил вымышленные сведения почти во всех 26.000 транскрипциях, созданных им с помощью Whisper.

Ученые из Корнельского университета, Университета Вашингтона и других учреждений обнаружили, что Whisper «галлюцинирует» примерно в 1% случаев, придумывая целые предложения во время пауз в записях. Исследователи отмечают, что паузы особенно часто встречаются при речи людей с афазией. Иногда выдуманные ИИ фразы содержат агрессию и расизм, а иногда — бессмыслицу.

Галлюцинации включали вымышленные медицинские термины или фразы, которые можно было бы ожидать от видео на YouTube, например, «Спасибо за просмотр!». Сообщается, что OpenAI использовала для расшифровки более 1 млн часов видео на YouTube для обучения GPT-4.

Все это создает серьезные риски, поскольку Whisper применяется в медицинских учреждениях. Так, Whisper используется компанией Nabla в качестве инструмента медицинской транскрипции. По ее оценкам, модель расшифровала 7 млн разговоров с врачами. Более 30.000 докторов и 40 систем здравоохранения используют ИИ-инструмент.*

В общем: супер-проект ИИ падает, как и предполагалось исходя из материалов, ранее изложенных в этом журнале***.

...Такие дела...

-------------------------------

*) Новости октября 2024 по ИИ

25 октября: OpenAI распустила команду по «встрече» универсального ИИ

https://hightech.plus/2024/10/25/openai-pokinul-glavnii-konsultant-po-gotovnosti-obshestva-k-silnomu-ii

28 октября: Используемая в больницах модель OpenAI оказалась подвержена галлюцинациям

https://hightech.plus/2024/10/28/ispolzuemaya-v-bolnicah-model-openai-okazalas-podverzhena-gallyucinaciyam

**) О бредовых обещаниях и неизбежных фейлах ИИ типа БЯМ

Искусственный интеллект влип в неосуществимое

https://t.me/mifofagos/66

Лемма Лема о ловушке машинного интеллекта

https://t.me/mifofagos/84

***) Ранее по теме в этом журнале

Все надежды человоща. Искусственный интеллект, как бог человощества.

https://alex-rozoff.livejournal.com/122271.html

Куда уехал цирк: этот искусственный интеллект (LLM) сломался, несите новый (KAN).

https://alex-rozoff.livejournal.com/786381.html

Наконец-то нашлись ученые, которые сказали прямо: AI типа LLM это лишь имитация говорящего попугая

https://alex-rozoff.livejournal.com/810190.html

Великий финансовый пузырь сверхчеловеческого искусственного интеллекта: цирк продолжается

https://alex-rozoff.livejournal.com/820035.html

И вновь продолжается цирк... Вокруг т.н. "искусственного интеллекта". Есть выход, но он не работает

https://alex-rozoff.livejournal.com/824436.html

Афера "Искусственный Интеллект" тонет, как Титаник. Ученые отплывают, чтоб не затянуло в воронку

https://alex-rozoff.livejournal.com/825567.html

Лидеры проектов т.н. "искусственного интеллекта", как и ожидалось, упали до уровня игры в наперстки

https://alex-rozoff.livejournal.com/826281.html

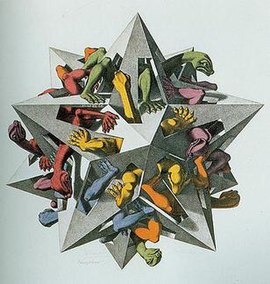

Картина: Эшер. Гравитация

25 октября OpenAI распустила команду консультантов, "оценивающих готовность общества к появлению универсального, или сильного ИИ". Признала провал? Вы будете смеяться, но нет. Основание для роспуска заявлено такое смешное, что все клоуны отдыхают.

Майлс Брандэйдж (глава теперь уже бывшей команды) объяснил это так: "Ни OpenAI, ни какая-либо другая передовая лаборатория не готовы к сильному ИИ, мир тоже не готов. Поясню, я не думаю, что в руководстве OpenAI это утверждение вызывает споры. И его не следует путать с вопросом, окажется ли компания и мир готовы в соответствующее время"

...Гм... Это что было?

Намек на демонстративную коммерциализацию OpenAI Сэмом Альтманом и раздачу бредовых обещаний?**

Или напоминание о бегстве ключевых фигур из OpenAI (включая Суцкевера и Мурати)?

А может, ужас перед лицом нового эпического фейла, о котором ниже:

[цитирую материал от 28.10] Генеративные модели искусственного интеллекта склонны к генерации некорректной информации. Удивительно, но эта проблема затронула и область автоматической транскрипции, где модель должна точно воспроизводить аудиозапись. По данным Associated Press, инженеры-программисты, разработчики и ученые серьезно обеспокоены расшифровками Whisper от OpenAI.

Исследователь из Мичиганского университета обнаружил галлюцинации в восьми из десяти аудиозаписей. Инженер по машинному обучению, изучивший более 100 часов транскрипций Whisper, нашел ошибки более чем в половине из них. А разработчик сообщил, что обнаружил вымышленные сведения почти во всех 26.000 транскрипциях, созданных им с помощью Whisper.

Ученые из Корнельского университета, Университета Вашингтона и других учреждений обнаружили, что Whisper «галлюцинирует» примерно в 1% случаев, придумывая целые предложения во время пауз в записях. Исследователи отмечают, что паузы особенно часто встречаются при речи людей с афазией. Иногда выдуманные ИИ фразы содержат агрессию и расизм, а иногда — бессмыслицу.

Галлюцинации включали вымышленные медицинские термины или фразы, которые можно было бы ожидать от видео на YouTube, например, «Спасибо за просмотр!». Сообщается, что OpenAI использовала для расшифровки более 1 млн часов видео на YouTube для обучения GPT-4.

Все это создает серьезные риски, поскольку Whisper применяется в медицинских учреждениях. Так, Whisper используется компанией Nabla в качестве инструмента медицинской транскрипции. По ее оценкам, модель расшифровала 7 млн разговоров с врачами. Более 30.000 докторов и 40 систем здравоохранения используют ИИ-инструмент.*

В общем: супер-проект ИИ падает, как и предполагалось исходя из материалов, ранее изложенных в этом журнале***.

...Такие дела...

-------------------------------

*) Новости октября 2024 по ИИ

25 октября: OpenAI распустила команду по «встрече» универсального ИИ

https://hightech.plus/2024/10/25/openai-pokinul-glavnii-konsultant-po-gotovnosti-obshestva-k-silnomu-ii

28 октября: Используемая в больницах модель OpenAI оказалась подвержена галлюцинациям

https://hightech.plus/2024/10/28/ispolzuemaya-v-bolnicah-model-openai-okazalas-podverzhena-gallyucinaciyam

**) О бредовых обещаниях и неизбежных фейлах ИИ типа БЯМ

Искусственный интеллект влип в неосуществимое

https://t.me/mifofagos/66

Лемма Лема о ловушке машинного интеллекта

https://t.me/mifofagos/84

***) Ранее по теме в этом журнале

Все надежды человоща. Искусственный интеллект, как бог человощества.

https://alex-rozoff.livejournal.com/122271.html

Куда уехал цирк: этот искусственный интеллект (LLM) сломался, несите новый (KAN).

https://alex-rozoff.livejournal.com/786381.html

Наконец-то нашлись ученые, которые сказали прямо: AI типа LLM это лишь имитация говорящего попугая

https://alex-rozoff.livejournal.com/810190.html

Великий финансовый пузырь сверхчеловеческого искусственного интеллекта: цирк продолжается

https://alex-rozoff.livejournal.com/820035.html

И вновь продолжается цирк... Вокруг т.н. "искусственного интеллекта". Есть выход, но он не работает

https://alex-rozoff.livejournal.com/824436.html

Афера "Искусственный Интеллект" тонет, как Титаник. Ученые отплывают, чтоб не затянуло в воронку

https://alex-rozoff.livejournal.com/825567.html

Лидеры проектов т.н. "искусственного интеллекта", как и ожидалось, упали до уровня игры в наперстки

https://alex-rozoff.livejournal.com/826281.html

Картина: Эшер. Гравитация

Published on October 29, 2024 12:56

Очередные провалы т.н. "исскусственного интеллекта" - "снегопад, снегопад, мы еще не готовы" (с)

Т.н. искусственный интеллект в виде больших языковых моделей продолжает пробивать днища*, громоздя все более феерические нелепости.

25 октября OpenAI распустила команду консультантов, "оценивающих готовность общества к появлению универсального, или сильного ИИ". Признала провал? Вы будете смеяться, но нет. Основание для роспуска заявлено такое смешное, что все клоуны отдыхают.

Майлс Брандэйдж (глава теперь уже бывшей команды) объяснил это так: "Ни OpenAI, ни какая-либо другая передовая лаборатория не готовы к сильному ИИ, мир тоже не готов. Поясню, я не думаю, что в руководстве OpenAI это утверждение вызывает споры. И его не следует путать с вопросом, окажется ли компания и мир готовы в соответствующее время"

...Гм... Это что было?

Намек на демонстративную коммерциализацию OpenAI Сэмом Альтманом и раздачу бредовых обещаний?**

Или напоминание о бегстве ключевых фигур из OpenAI (включая Суцкевера и Мурати)?

А может, ужас перед лицом нового эпического фейла, о котором ниже:

[цитирую материал от 28.10] Генеративные модели искусственного интеллекта склонны к генерации некорректной информации. Удивительно, но эта проблема затронула и область автоматической транскрипции, где модель должна точно воспроизводить аудиозапись. По данным Associated Press, инженеры-программисты, разработчики и ученые серьезно обеспокоены расшифровками Whisper от OpenAI.

Исследователь из Мичиганского университета обнаружил галлюцинации в восьми из десяти аудиозаписей. Инженер по машинному обучению, изучивший более 100 часов транскрипций Whisper, нашел ошибки более чем в половине из них. А разработчик сообщил, что обнаружил вымышленные сведения почти во всех 26.000 транскрипциях, созданных им с помощью Whisper.

Ученые из Корнельского университета, Университета Вашингтона и других учреждений обнаружили, что Whisper «галлюцинирует» примерно в 1% случаев, придумывая целые предложения во время пауз в записях. Исследователи отмечают, что паузы особенно часто встречаются при речи людей с афазией. Иногда выдуманные ИИ фразы содержат агрессию и расизм, а иногда — бессмыслицу.

Галлюцинации включали вымышленные медицинские термины или фразы, которые можно было бы ожидать от видео на YouTube, например, «Спасибо за просмотр!». Сообщается, что OpenAI использовала для расшифровки более 1 млн часов видео на YouTube для обучения GPT-4.

Все это создает серьезные риски, поскольку Whisper применяется в медицинских учреждениях. Так, Whisper используется компанией Nabla в качестве инструмента медицинской транскрипции. По ее оценкам, модель расшифровала 7 млн разговоров с врачами. Более 30.000 докторов и 40 систем здравоохранения используют ИИ-инструмент.*

В общем: супер-проект ИИ падает, как и предполагалось исходя из материалов, ранее изложенных в этом журнале***.

...Такие дела...

-------------------------------

*) Новости октября 2024 по ИИ

25 октября: OpenAI распустила команду по «встрече» универсального ИИ

https://hightech.plus/2024/10/25/openai-pokinul-glavnii-konsultant-po-gotovnosti-obshestva-k-silnomu-ii

28 октября: Используемая в больницах модель OpenAI оказалась подвержена галлюцинациям

https://hightech.plus/2024/10/28/ispolzuemaya-v-bolnicah-model-openai-okazalas-podverzhena-gallyucinaciyam

**) О бредовых обещаниях и неизбежных фейлах ИИ типа БЯМ

Искусственный интеллект влип в неосуществимое

https://t.me/mifofagos/66

Лемма Лема о ловушке машинного интеллекта

https://t.me/mifofagos/84

***) Ранее по теме в этом журнале

Все надежды человоща. Искусственный интеллект, как бог человощества.

https://alex-rozoff.livejournal.com/122271.html

Куда уехал цирк: этот искусственный интеллект (LLM) сломался, несите новый (KAN).

https://alex-rozoff.livejournal.com/786381.html

Наконец-то нашлись ученые, которые сказали прямо: AI типа LLM это лишь имитация говорящего попугая

https://alex-rozoff.livejournal.com/810190.html

Великий финансовый пузырь сверхчеловеческого искусственного интеллекта: цирк продолжается

https://alex-rozoff.livejournal.com/820035.html

И вновь продолжается цирк... Вокруг т.н. "искусственного интеллекта". Есть выход, но он не работает

https://alex-rozoff.livejournal.com/824436.html

Афера "Искусственный Интеллект" тонет, как Титаник. Ученые отплывают, чтоб не затянуло в воронку

https://alex-rozoff.livejournal.com/825567.html

Лидеры проектов т.н. "искусственного интеллекта", как и ожидалось, упали до уровня игры в наперстки

https://alex-rozoff.livejournal.com/826281.html

Картина: Эшер. Гравитация

25 октября OpenAI распустила команду консультантов, "оценивающих готовность общества к появлению универсального, или сильного ИИ". Признала провал? Вы будете смеяться, но нет. Основание для роспуска заявлено такое смешное, что все клоуны отдыхают.

Майлс Брандэйдж (глава теперь уже бывшей команды) объяснил это так: "Ни OpenAI, ни какая-либо другая передовая лаборатория не готовы к сильному ИИ, мир тоже не готов. Поясню, я не думаю, что в руководстве OpenAI это утверждение вызывает споры. И его не следует путать с вопросом, окажется ли компания и мир готовы в соответствующее время"

...Гм... Это что было?

Намек на демонстративную коммерциализацию OpenAI Сэмом Альтманом и раздачу бредовых обещаний?**

Или напоминание о бегстве ключевых фигур из OpenAI (включая Суцкевера и Мурати)?

А может, ужас перед лицом нового эпического фейла, о котором ниже:

[цитирую материал от 28.10] Генеративные модели искусственного интеллекта склонны к генерации некорректной информации. Удивительно, но эта проблема затронула и область автоматической транскрипции, где модель должна точно воспроизводить аудиозапись. По данным Associated Press, инженеры-программисты, разработчики и ученые серьезно обеспокоены расшифровками Whisper от OpenAI.

Исследователь из Мичиганского университета обнаружил галлюцинации в восьми из десяти аудиозаписей. Инженер по машинному обучению, изучивший более 100 часов транскрипций Whisper, нашел ошибки более чем в половине из них. А разработчик сообщил, что обнаружил вымышленные сведения почти во всех 26.000 транскрипциях, созданных им с помощью Whisper.

Ученые из Корнельского университета, Университета Вашингтона и других учреждений обнаружили, что Whisper «галлюцинирует» примерно в 1% случаев, придумывая целые предложения во время пауз в записях. Исследователи отмечают, что паузы особенно часто встречаются при речи людей с афазией. Иногда выдуманные ИИ фразы содержат агрессию и расизм, а иногда — бессмыслицу.

Галлюцинации включали вымышленные медицинские термины или фразы, которые можно было бы ожидать от видео на YouTube, например, «Спасибо за просмотр!». Сообщается, что OpenAI использовала для расшифровки более 1 млн часов видео на YouTube для обучения GPT-4.

Все это создает серьезные риски, поскольку Whisper применяется в медицинских учреждениях. Так, Whisper используется компанией Nabla в качестве инструмента медицинской транскрипции. По ее оценкам, модель расшифровала 7 млн разговоров с врачами. Более 30.000 докторов и 40 систем здравоохранения используют ИИ-инструмент.*

В общем: супер-проект ИИ падает, как и предполагалось исходя из материалов, ранее изложенных в этом журнале***.

...Такие дела...

-------------------------------

*) Новости октября 2024 по ИИ

25 октября: OpenAI распустила команду по «встрече» универсального ИИ

https://hightech.plus/2024/10/25/openai-pokinul-glavnii-konsultant-po-gotovnosti-obshestva-k-silnomu-ii

28 октября: Используемая в больницах модель OpenAI оказалась подвержена галлюцинациям

https://hightech.plus/2024/10/28/ispolzuemaya-v-bolnicah-model-openai-okazalas-podverzhena-gallyucinaciyam

**) О бредовых обещаниях и неизбежных фейлах ИИ типа БЯМ

Искусственный интеллект влип в неосуществимое

https://t.me/mifofagos/66

Лемма Лема о ловушке машинного интеллекта

https://t.me/mifofagos/84

***) Ранее по теме в этом журнале

Все надежды человоща. Искусственный интеллект, как бог человощества.

https://alex-rozoff.livejournal.com/122271.html

Куда уехал цирк: этот искусственный интеллект (LLM) сломался, несите новый (KAN).

https://alex-rozoff.livejournal.com/786381.html

Наконец-то нашлись ученые, которые сказали прямо: AI типа LLM это лишь имитация говорящего попугая

https://alex-rozoff.livejournal.com/810190.html

Великий финансовый пузырь сверхчеловеческого искусственного интеллекта: цирк продолжается

https://alex-rozoff.livejournal.com/820035.html

И вновь продолжается цирк... Вокруг т.н. "искусственного интеллекта". Есть выход, но он не работает

https://alex-rozoff.livejournal.com/824436.html

Афера "Искусственный Интеллект" тонет, как Титаник. Ученые отплывают, чтоб не затянуло в воронку

https://alex-rozoff.livejournal.com/825567.html

Лидеры проектов т.н. "искусственного интеллекта", как и ожидалось, упали до уровня игры в наперстки

https://alex-rozoff.livejournal.com/826281.html

Картина: Эшер. Гравитация

Published on October 29, 2024 12:56

Александр Александрович Розов's Blog

- Александр Александрович Розов's profile

- 13 followers

Александр Александрович Розов isn't a Goodreads Author

(yet),

but they

do have a blog,

so here are some recent posts imported from

their feed.